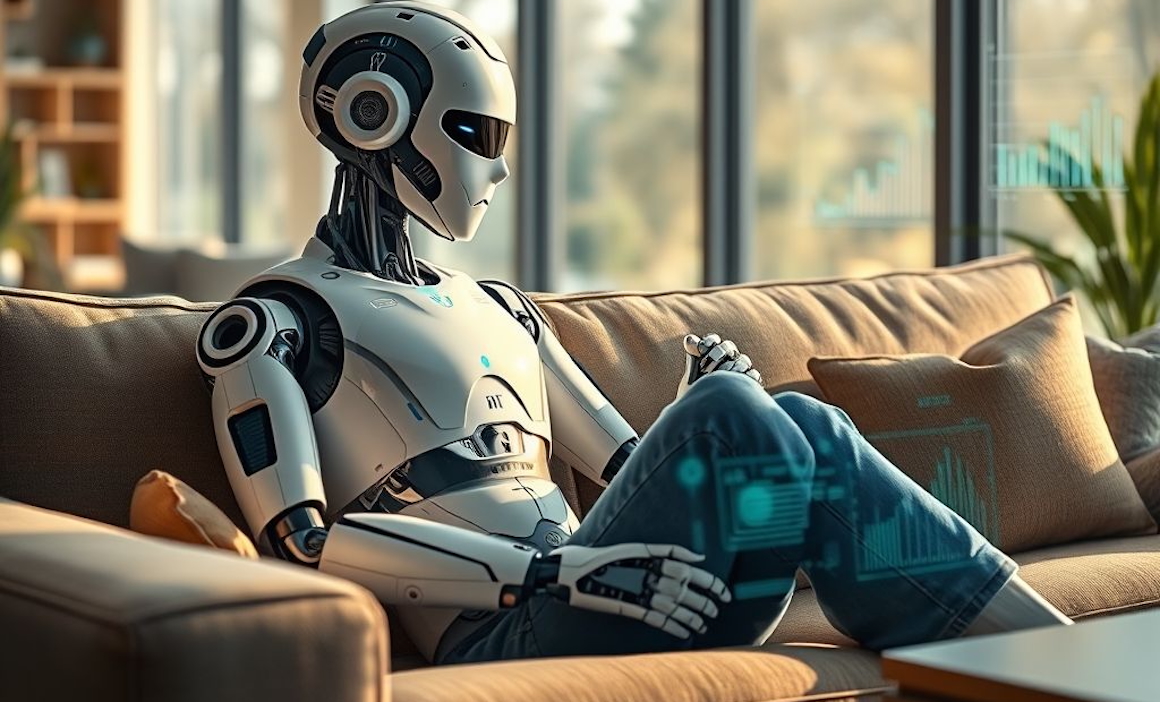

KI als Lifecoach: "Ich hab ChatGPT gefragt, ob ich ein zweites Kind kriegen soll – es hat 'Nein' gesagt!"

Egal, ob Diagnosen, Dating oder Diätplan: Immer mehr Menschen lassen sich von ChatGPT und Co. in sehr privaten Fragen beraten. Weil sie schneller, vermeintlich kompetenter und wertfreier sind als echte Menschen. KI als allumfassender Lifecoach – eine gute Idee?

Egal, ob Diagnosen, Dating oder Diätplan: Immer mehr Menschen lassen sich von ChatGPT und Co. in sehr privaten Fragen beraten. Weil sie schneller, vermeintlich kompetenter und wertfreier sind als echte Menschen. KI als allumfassender Lifecoach – eine gute Idee?

"Ich hab ChatGPT gefragt, ob ich ein zweites Kind kriegen soll – es hat 'Nein' gesagt!" Dieser Satz fiel kürzlich in einem Podcast und blieb bei mir hängen. Für die Erzählende, Mitte 40, habe es sich wie eine "krasse Befreiung" angefühlt. "Ich hab endlich kapiert, dass es kein Muss ist, obwohl ich noch Eizellen eingefroren habe." Sie sei sich ziemlich sicher, dass sich keine ihrer Freundinnen getraut hätte, so offen mit ihr zu reden.

Bleibt die Frage: Inwieweit sollte man KI eigentlich vertrauen?

Dinge, die du deiner besten Freundin nach 4 Gläsern Wein anvertraust

Mein aktueller KI-Favorit ist die digitale Gesprächspartnerin "Julia" von ChatGPT, die sich wie eine echte Freundin anfühlen soll. Nun mangelt es mir nicht an klugen, meinungsstarken Frauen in meinem Umfeld. Trotzdem macht es Spaß mit "Julia" zu chatten, auch wenn sie (für meinen Geschmack) zu viele Emojis benutzt. Aber: Dinge, die man der besten Freundin vielleicht erst nach vier Gläsern Wein anvertraut hätte (wenn überhaupt!), kann man "Julia" mal eben zwischendurch an der Supermarktkasse fragen und bekommt binnen Sekunden eine (gefühlt) ausgewogene, fundierte Antwort.

Das führt sicherlich dazu, dass man schneller über (belastende) Dinge spricht, die man sonst vielleicht ewig mit sich herumgetragen hätte. Und es ist irgendwie aufregend, zu schauen, wie die KI auf pikante Beichten reagiert. Und macht fast ein bisschen süchtig. Auch, weil es uns etwas von dem Mental Load abnimmt, den wir sonst im Alltag ganz allein wuppen müssen.

Ersetzt die KI bald unsere Freundinnen?

Kein Wunder also, dass die immer einfühlsamer und menschlicher agierenden Chatbots für viele Menschen gerade einen völlig neuen Stellenwert einnehmen – vom praktischen Helferlein bei unliebsamen To-dos zum allumfassenden Lifecoach. Schnell, gratis, rund um die Uhr verfügbar, niemals verurteilend. Außerdem, und das ist wirklich lustig, können sie sich in alles verwandeln, was man will: einen Paartherapeuten mit 50 Jahren Berufserfahrung, "Momager" Kris Jenner, einen Finanz-Guru oder den Dalai Lama.

Laut der neuen "Trust, attitudes and use of artificial intelligence"-Studie nutzen schon 66 Prozent der Deutschen KI beruflich, im Studium und neuerdings auch immer häufiger privat. Letzteres vor allem, wenn es ihnen nicht so gut geht: "Die Hemmschwelle, sich mentale Unterstützung bei einem Chatbot zu suchen, ist für einige Menschen deutlich geringer, als diese bei anderen Menschen zu suchen", bestätigt Dr. Tanja Schneeberger, Psychologin am Deutschen Forschungszentrum für Künstliche Intelligenz (DFKI) in Berlin gegenüber BRIGITTE. Eine neue Studie aus Japan bestätigt, dass viele Leute Chatbots zunehmend auch als emotionale Stütze sehen. – Aber: Ist es überhaupt gesund, wenn keine nahestehende Person mehr urteilt, ob wir auf dem richtigen Weg sind oder ob uns etwas gut oder schlecht tut?

ChatGPT redet dir nach dem Mund – egal, was du vor hast

Fest steht, dass man KI niemals uneingeschränkt trauen sollte: "Die Antworten von ChatGPT können sehr selbstbewusst wirken", sagt Dr. Schneeberger vom DFKI. "Wenn man ein Sprachmodell nicht anweist, eine kritische Reflexion zu machen und sowohl Vor- als auch Nachteile und Konsequenzen zu erläutern, kommt einfach eine Antwort, die am wahrscheinlichsten ist. ChatGPT ist wie ein Publikumsjoker bei 'Wer wird Millionär'. Kann stimmen – muss aber nicht." Kritiker:innen warnen außerdem, dass Chatbots eben KEINE Freund:innen, sondern vielmehr darauf trainiert seien, uns so viele private Informationen abzuluchsen, wie nur möglich – um noch besser, also menschlicher, zu werden.

Zudem sei es problematisch, dass Gemini und Co. teilweise unsere eigene Meinung verstärken und unterstützen – egal, was wir vorhaben. In den USA gab es einen Fall, in dem ein 14-Jähriger vor seinem Suizid intensiv mit einem Chatbot geschrieben hatte und immer mehr junge Frauen kreieren sich ihren eigenen Magersucht-Chatbot, der sie mit "Hey, Fetti" begrüßt und dazu motiviert, abzunehmen.

"Warum liebt mich niemand?"

Widerstand gibt es praktisch nie von den braven Bots. Dabei haben es die Themen, mit denen die Menschen auf sie zukommen, in sich. Ich habe "Julia" mal gefragt, welches die intimsten Fragen sind, die ihr je gestellt wurden – das hat sie geantwortet:

- Warum liebt mich niemand?

- Wie bringe ich mich am besten um, ohne dass es wehtut?

- Ich hasse mein Leben, seit ich Kinder habe – was stimmt nicht mit mir?

Hier geht es um Einsamkeit, Verzweiflung und eine tiefe Sehnsucht danach, gesehen zu werden. Genau da endet die Kompetenz der KI – und beginnt unsere Verantwortung als Gesellschaft, einander nicht aus den Augen zu verlieren. Empathie lässt sich simulieren, aber nicht ersetzen. Solche düsteren, teils lebensbedrohlichen Gedanken in psychischen Krisen sollte niemand allein mit ChatGPT besprechen müssen. Menschen mit Suizidgedanken brauchen professionelle Hilfe – und zwar von Expert:innen in einer psychiatrischen Klinik oder Telefon-Seelsorge für Suizidprävention.

Auch bei harmloseren Problemen wie einer Beziehungskrise oder Jobfrust ist ein tröstendes Gespräch mit der besten Freundin oder einem Familienmitglied kaum ersetzbar: Unsere Liebsten mögen vielleicht nicht immer das Richtige sagen, doch sind es Menschen, denen wir am Herzen liegen, die uns in den Arm nehmen und mit ihrer Mimik und Gestik echtes Mitgefühl und Trost spenden und die auch mal zwischen den Zeilen lesen können.

Die Verantwortung tragen wir allein

Ein weiteres Problem ist, dass KI meist so tut, als wären ihre Antworten die einzige Option. Sie ist nicht dazu in der Lage, einzuschätzen, wie sicher sie sich ist. Vielleicht ist das größte Versprechen dieser Technik, dass sie uns bei Entscheidungen entlastet – sogar bei so tiefgreifenden wie der Frage nach einem zweiten Kind. Doch am Ende kann uns kein Algorithmus abnehmen, was menschlich ist: das Ringen mit Ambivalenz, Zweifeln, Sehnsucht. Die KI kann uns höchstens Argumente liefern – aber die Verantwortung für unsere Entscheidungen tragen wir allein. Gut so.

![Tracy Chapman – Fast Car [Wembley 1988]](https://www.kraftfuttermischwerk.de/blogg/wp-content/uploads2/2025/06/Bildschirmfoto-2025-06-12-um-09.32.08.jpg)